大模型演变

更新: 4/16/2026 字数: 0 字 时长: 0 分钟

什么是好的Agent

好的Agent= 明确的上下文(Context)+ 明确的需求 + 好用的工具

Tool的演变

大模型本身并不执行工具,只是知道当前有这么一个工具,然后向外界传输我要使用这个工具的命令,然后我们再去执行命令,并将结果返回给大模型

- Function Call:向大模型告诉工具的作用,大模型在感觉自己要用的时候就会返回一个调用这个工具的标志,我们的agent项目通过这个标志来调用我们代码中的工具

- MCP:实现了Function Call与Agent项目的解耦,将Tool服务化,现在我们只需要下载(stdio)或远程连接(SSE),就可以直接使用我们的MCP,MCP客户端会将MCP作为提示词输入给大模型,可以给不支持Function Call的模型也提供工具服务

- skills:skills为按需加载,大模型只会提前加载Skills中的yaml文件内容,让AI自己选择是否要调用,同时会提供script作为执行脚本,reference作为外加知识,SKILL.md则提供了完全的执行流程和约束,由于Skills是通过脚本+文档形成的,所以耦合度达到了最低

注意: 这里有一个地方,就是虽然Function Call和MCP都是通过提示词注入的方式告诉大模型有哪些工具,但Function Call的实现是利用大模型微调实现的,当它们看到 System Prompt 中的工具定义时,不是在尝试“模仿”某种格式,而是触发了内部的一种特定的预测模式,

而MCP则是靠的存粹的上下文引导

Agent Coding 和 Chat Coding的区别

Agent对chat添加了大量的约束,使我们大模型在写代码的时候有了优化,我们可以规范的写代码,这里其实就是最开始提出的问题中没有好的上下文

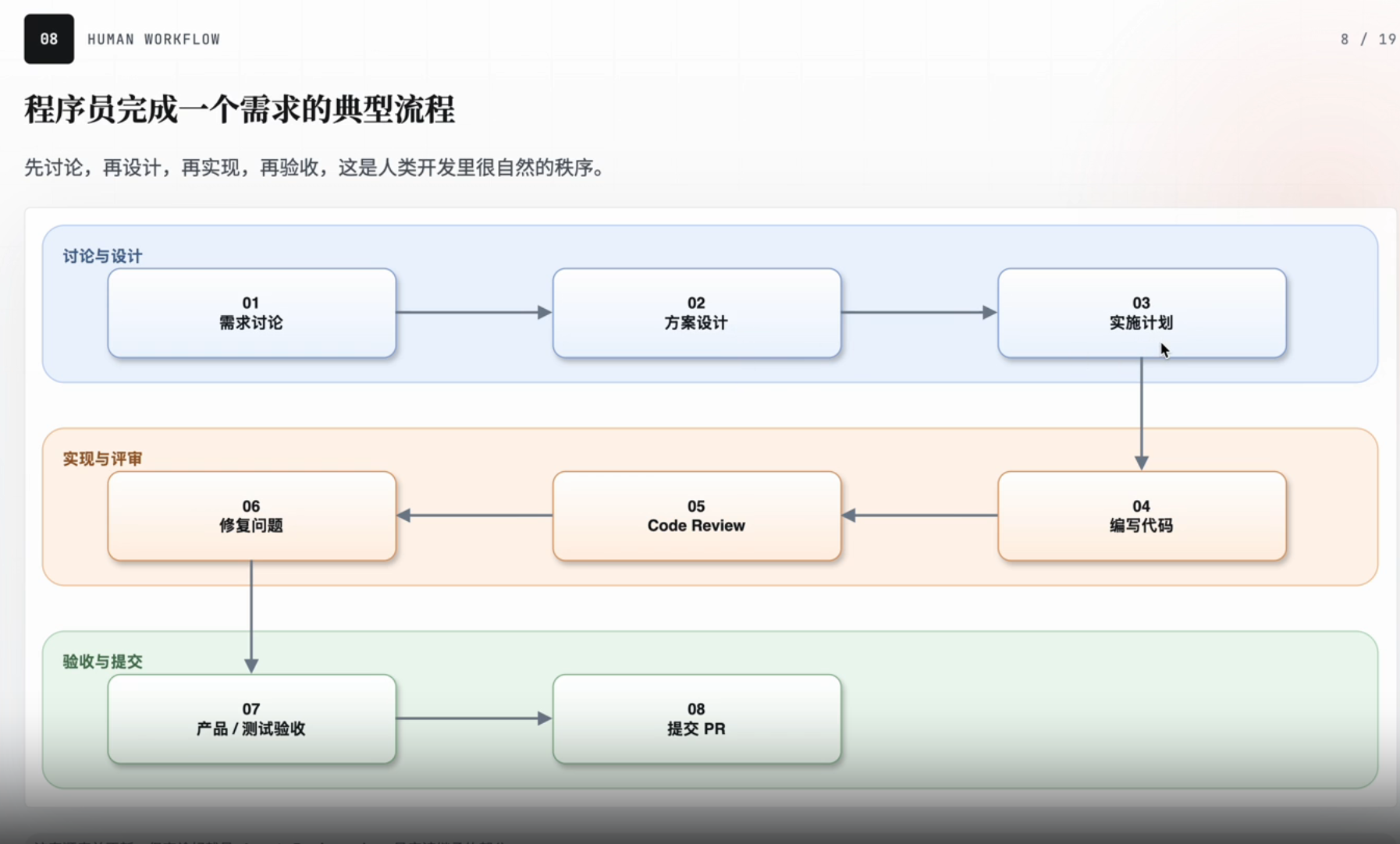

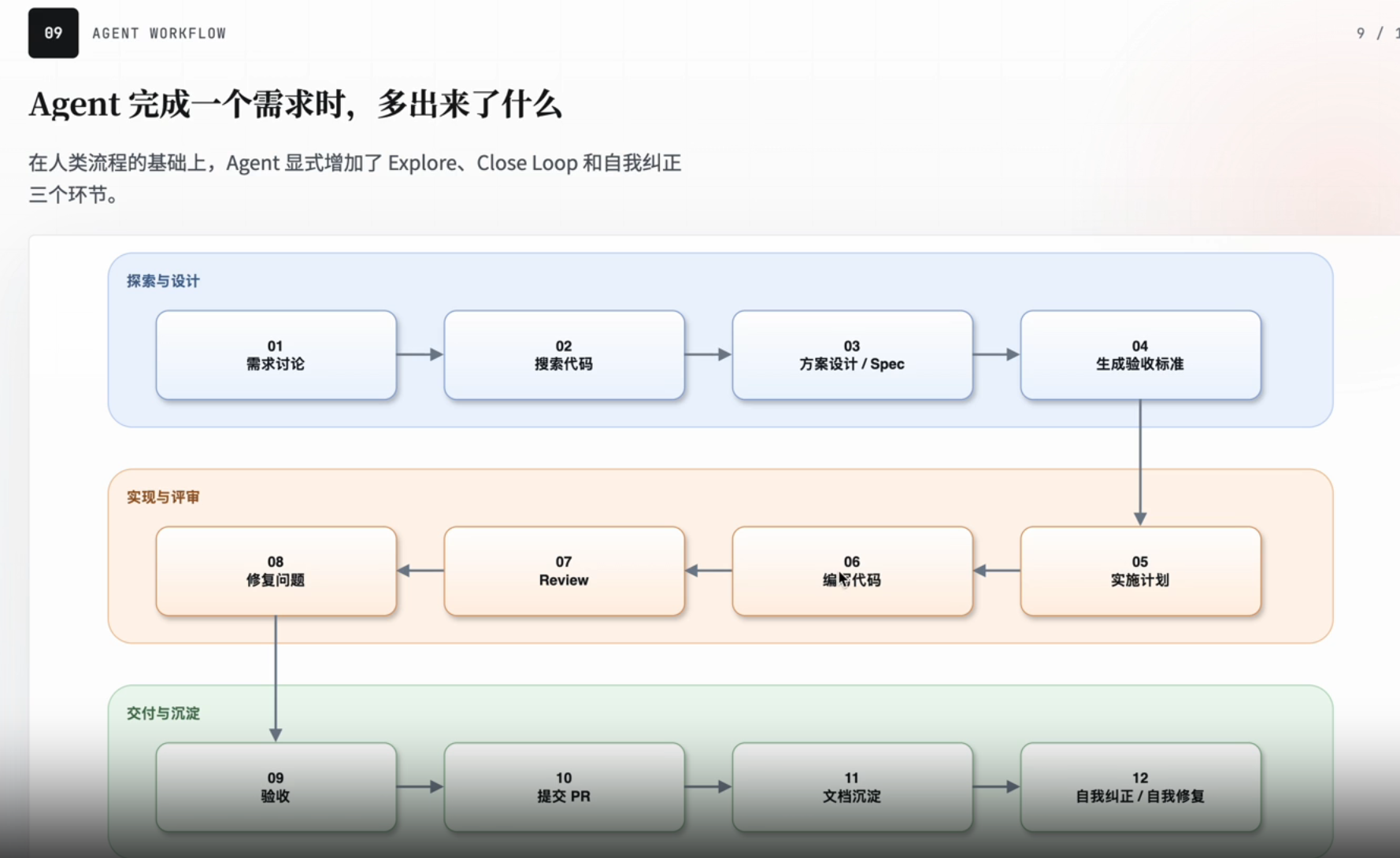

Agent Coding 与 古法Coding 的区别

Agent Coding在古法Coding的多了生成标准验收,实施计划和自我纠正的步骤,这几个步骤都是为了 规范AI,让AI不断的自我审查,制定计划,这样就能让AI输出的内容更加规范

在这些方式下,AI的流程是闭环的,显式的,我们可以在外部观测AI究竟想了什么,可以提前终止AI,AI在自己执行某些命令失败之后可以不断的自我检查修改

甚至,我们可以针对不同步骤的难易程度,使用不同强度的模型,进而控制我们的一次对话的成本,这也就是Multi-Agent的设计

由此我们不难发现,所谓的多Agent其实就是任务编排,任务编排就是系统设计

我们看到的一些特别长的上下文的Agent,实际上也是由多Agent实现的,由主Agent掌管编排和与用户对话,副Agent进行代码书写等一系列工作

注意: 这里的主副Agent也可以是同一个模型的不同实例